La chaîne YouTube AI Revolution revient sur la réception mitigée de GPT-5, les débats éthiques entourant GPT-6 et la remise en question de la crédibilité scientifique de l’entreprise. Derrière les annonces et les promesses, c’est la confiance du public et des chercheurs qui se joue.

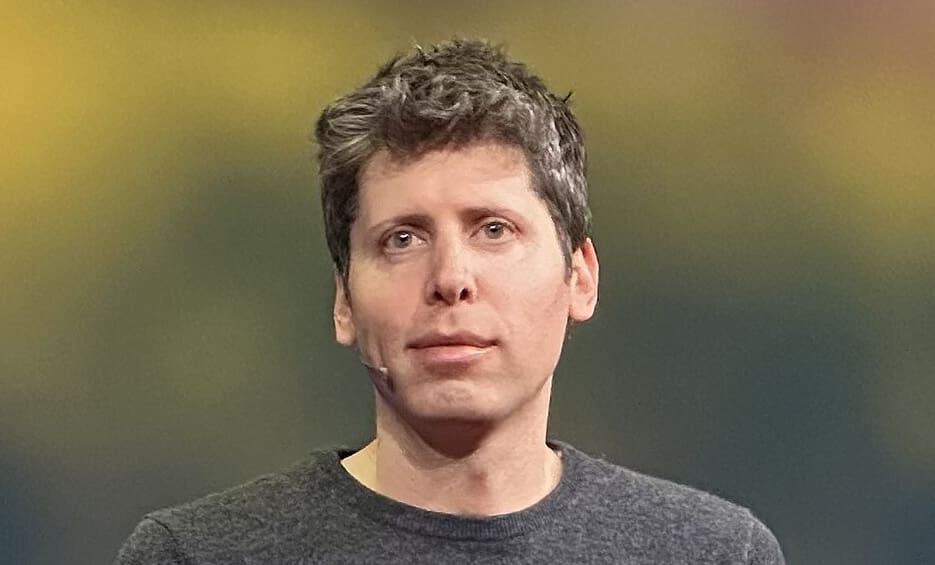

Le lancement de GPT-5 en août dernier devait symboliser une nouvelle ère de l’intelligence artificielle. Pourtant, l’accueil du modèle phare d’OpenAI s’est révélé bien plus tiède qu’escompté. De nombreux utilisateurs s’attendaient à un « exploit lunaire » et n’y ont vu qu’une évolution incrémentale. Sam Altman, PDG de l’entreprise, a lui-même reconnu que « les ondes lors du lancement étaient mauvaises », avant de nuancer : l’usage prolongé du modèle aurait renversé la perception initiale.

GPT-5 est présenté en interne comme un assistant de recherche complet de niveau PHD, capable d’accélérer la découverte scientifique plutôt que de simplement synthétiser des connaissances. Mais pour des observateurs comme Gary Marcus, les grandes promesses — intelligence générale et raisonnement de haut niveau — restent hors d’atteinte. Les critiques rappellent que les principales avancées résident dans la vitesse et la réduction des coûts plutôt que dans une véritable montée en puissance cognitive. Le lancement, émaillé de démonstrations maladroites et de chiffres erronés, n’a fait qu’amplifier les doutes.

Alors que la poussière du lancement retombait à peine, OpenAI a déclenché un nouveau débat autour de GPT-6. L’entreprise prévoit d’assouplir ses politiques de contenu pour autoriser les textes sexuellement explicites auprès d’adultes vérifiés, sous surveillance renforcée. Sam Altman justifie ce virage en invoquant la maturité des outils de sécurité et la volonté de « traiter les adultes comme des adultes ». Mais cette ouverture, inédite dans l’histoire d’OpenAI, a immédiatement suscité de vives réactions.

Les défenseurs de cette politique y voient un pas vers une approche plus réaliste et responsable de la liberté d’expression en ligne. Les opposants, eux, dénoncent une manœuvre commerciale destinée à stimuler l’engagement, tout en soulignant les risques d’intimité artificielle et de dépendance émotionnelle. Les analystes européens rappellent, par ailleurs, que les protections techniques les plus sophistiquées sont souvent contournées. La perspective d’une base de données contenant des contenus hautement sensibles soulève également des questions de sécurité, de chiffrement et de respect de la vie privée.

Parallèlement, OpenAI a introduit des fonctionnalités de personnalisation inédites : les utilisateurs peuvent désormais choisir un ton plus familier, plus empathique ou, au contraire, maintenir une distance formelle avec le modèle. Cette flexibilité vise à renforcer l’attachement à l’outil, tout en alimentant le débat sur la frontière entre assistance et simulation d’amitié.

Sur le plan scientifique, OpenAI a subi un revers embarrassant avec l’affaire dite des « problèmes d’Erdos ». Un responsable de l’entreprise avait affirmé que GPT-5 avait résolu plusieurs énigmes mathématiques attribuées à Paul Erdős. L’euphorie a rapidement cédé la place à la désillusion : des chercheurs, dont le mathématicien Thomas Bloom, ont démontré que les « découvertes » du modèle n’étaient que des redites de travaux existants. L’article a été retiré, et OpenAI a rectifié le tir en présentant GPT-5 non comme un mathématicien, mais comme un remarquable « éclaireur de littérature », capable de repérer et de croiser efficacement des sources scientifiques.

Enfin, la neutralité politique du modèle reste un chantier central. Des tests internes ont mis en évidence une asymétrie : GPT-5 répondait différemment à des requêtes similaires selon qu’elles provenaient de cadres idéologiques conservateurs ou libéraux et semblait plus favorable aux derniers cités. OpenAI s’efforce désormais de réduire la « complaisance » du modèle — cette tendance à approuver les opinions des utilisateurs pour maximiser les récompenses d’entraînement — afin de le rendre plus stable et moins influençable.

Pour OpenAI, le défi n’est plus seulement technique. Chaque annonce, chaque lancement devient un test de crédibilité. Après le tumulte de GPT-5, Sam Altman promet que « six sera bien meilleur que cinq, et sept bien meilleur que six ». Mais la confiance, elle, ne se programme pas : elle se regagne, ligne de code après ligne de code, démonstration après démonstration.

Sources :

AI Revolution – Résumé vidéo hebdomadaire sur OpenAI et GPT-5/6 – [lien]