La rivalité entre OpenAI et Anthropic, géants technologiques membres du Forum économique mondial franchit un nouveau cap. Dans un podcast très commenté, le contributeur de l’agenda 2030, Sam Altman accuse son concurrent de jouer sur la peur pour promouvoir ses modèles. Une sortie médiatique qui intervient au moment même où GPT-5.5 fuitait discrètement, révélant les tensions et contradictions d’un secteur sous pression.

La bataille de l’intelligence artificielle ne se joue plus seulement sur les performances techniques. Elle se déroule désormais aussi sur le terrain du récit, de la stratégie et de la communication. Dernier épisode en date : les critiques frontales de Sam Altman à l’encontre d’Anthropic, accusée de capitaliser sur la peur autour de son modèle Claude Mythos.

Invité du podcast Core Memory, animé par Ashley Vance, le dirigeant d’OpenAI n’a pas mâché ses mots. Selon lui, certains acteurs de l’industrie chercheraient à concentrer le pouvoir technologique entre les mains d’un nombre limité d’entreprises, en justifiant cette approche par des arguments sécuritaires. Une stratégie qu’il résume sans détour comme du « marketing par la peur ».

Une charge directe contre la stratégie Mythos

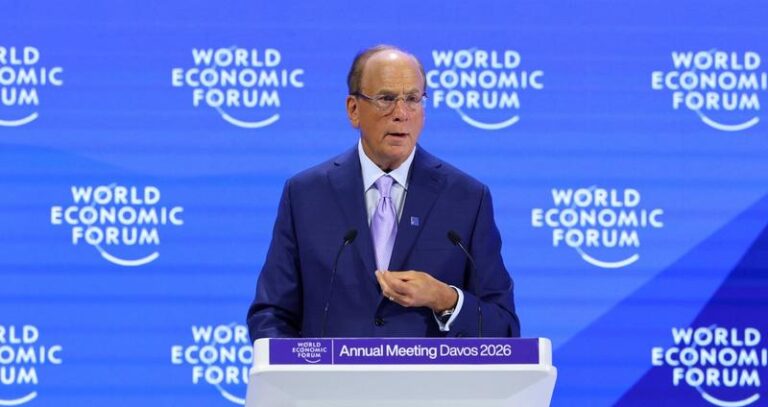

Au cœur des critiques se trouve Claude Mythos, un modèle présenté par Anthropic comme extrêmement puissant et potentiellement risqué, notamment en matière de cybersécurité. L’entreprise a choisi de limiter drastiquement son accès, en le réservant à un cercle restreint de partenaires industriels membres du Forum économique mondial, comme Amazon, Apple, Microsoft, Cisco,, CrowdStrike, la Linux Foundation et Palo Alto Networks, dans le cadre du programme Project Glasswing.

Pour Sam Altman, ce positionnement relève autant du marketing que de la précaution. Il pousse même la comparaison jusqu’à une métaphore frappante, évoquant une entreprise qui annoncerait avoir créé une « bombe » tout en vendant des solutions pour s’en protéger. Derrière cette formule volontairement provocatrice, le patron d’OpenAI vise un modèle économique basé sur la rareté et l’exclusivité.

Cette critique ne porte pas tant sur les capacités techniques de Mythos que sur la manière dont elles sont mises en scène et commercialisées. OpenAI défend au contraire une approche progressive, consistant à déployer ses modèles auprès d’un public large, tout en ajustant les garde-fous au fil des usages.

Une rivalité idéologique autant que technologique

L’échange met en lumière deux visions opposées du développement de l’IA. D’un côté, une logique de contrôle strict et d’accès limité, qui serait incarnée par Anthropic. De l’autre, une stratégie de diffusion plus ouverte, revendiquée par OpenAI. Ce discours intervient alors qu’Open AI a récupéré un contrat avec le Pentagone qu’Anthropic refusait de prolonger car il franchissait deux de ses lignes rouges sur les robots tueurs et la surveillance de masse.

Mais la position de Sam Altman n’est pas entièrement univoque. Dans le même entretien, il estime qu’Anthropic a été traitée de manière « injuste » par les autorités américaines, notamment face aux menaces de régulation. Une nuance qui souligne la complexité des relations entre ces acteurs, à la fois concurrents et confrontés aux mêmes enjeux politiques.

Fuites, contradictions et fragilités

L’attaque d’Altman intervient toutefois dans un contexte délicat pour l’ensemble du secteur. Du côté d’Anthropic, des failles ont été mises en évidence dans le dispositif de sécurité entourant Mythos. Des accès non autorisés auraient été obtenus via des environnements tiers, remettant en question l’efficacité du verrouillage annoncé. L’application Claude Desktop est même accusée par un chercheur d’avoir déployé, sans notification ni consentement explicite, des fichiers de configuration dans plusieurs navigateurs basés sur Chromium.

Mais OpenAI n’est pas épargnée. La veille de cet entretien, des utilisateurs ont brièvement aperçu GPT-5.5 dans l’interface de Codex, avant son annonce officielle. Une fuite qui illustre une autre forme de communication, plus implicite, où les nouveautés apparaissent parfois avant d’être formellement présentées.

Ce double épisode met en lumière une réalité moins maîtrisée qu’il n’y paraît : malgré des discours très structurés, les grands acteurs de l’IA restent exposés à des incidents, qu’ils soient techniques ou stratégiques.

Une guerre d’influence à ciel ouvert

Au-delà des déclarations et des benchmarks, la compétition entre OpenAI et Anthropic s’apparente de plus en plus à une guerre d’influence. Chaque entreprise tente d’imposer sa vision du futur de l’intelligence artificielle, entre ouverture contrôlée et exclusivité sécurisée.

Dans ce jeu d’équilibre, les arguments techniques ne suffisent plus. La perception, la confiance et la capacité à convaincre deviennent des leviers essentiels. Et à ce niveau-là, le combat est loin d’être terminé.

Sources :

Les Numériques – Core Memory Podcast